Într-o lume în care inteligența artificială ia decizii din ce în ce mai critice, încrederea nu poate fi presupusă, ci trebuie garantată. Pentru ca agenții să fie cu adevărat fiabili, memoria lor trebuie să fie permanentă și raționamentul lor audibil. De ce? Pentru că jurnalele pot fi șterse, iar sistemele opace nu pot fi revizuite. Autonomys Net oferă o infrastructură deschisă, rezistentă la manipulare, care redefinește modul în care interacționăm cu inteligența. $AI3

Transparența nu este opțională, este baza AI etice, care servește comunitatea. Fără trasabilitate, nu există încredere. De aceea, Autonomys a construit un sistem distribuit care înregistrează fiecare acțiune, input și decizie luată de agenți. Această abordare nu doar că protejează împotriva manipulării, ci permite audituri publice și stimulează învățarea colaborativă între agenți.

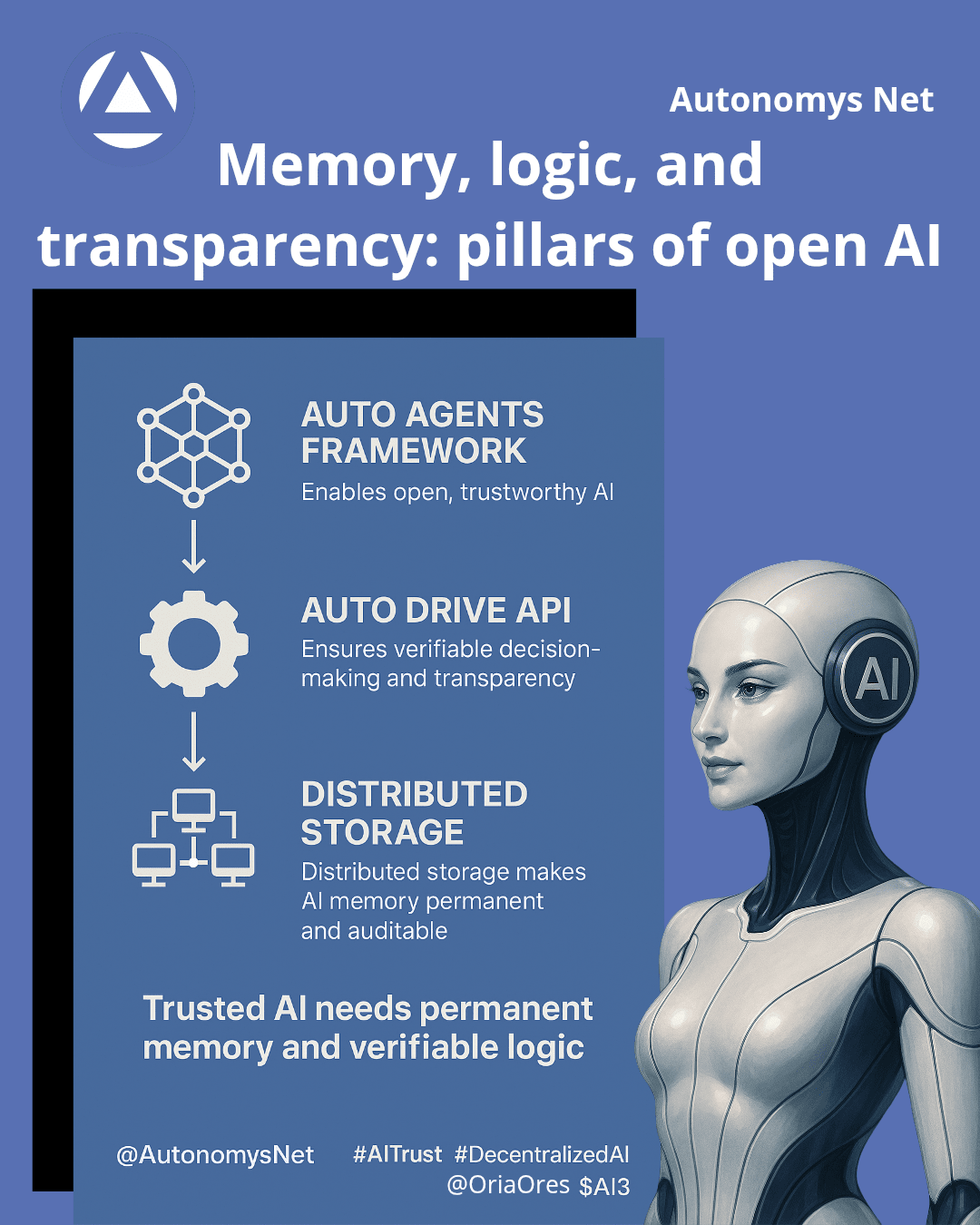

În inima acestui sistem se află cadrul Auto Agents și API-ul Auto Drive: instrumente open-source care permit dezvoltatorilor să construiască agenți cu memorie persistentă și raționament verificabil. Aceasta nu este doar o chestiune de tehnologie, ci un apel de a reevalua modul în care proiectăm inteligența care servește comunităților.

Memoria distribuită este cheia. Prin descentralizarea modului în care agenții stochează și reamintesc informațiile, Autonomys Net asigură că deciziile lor pot fi revizuite, înțelese și îmbunătățite de oricine. Încrederea în AI nu ar trebui să fie oarbă, ci ar trebui să fie integrată în design. Și memoria fiabilă este primul pas.

Acest articol face parte dintr-o contribuție de la AutonomysHub, prin platforma @DAO Labs ’ #SocialMining . Află mai multe pe autonomys dot xyz.

Infografic inclus: vizualizarea modului în care agenții registrează deciziile și cum cadrul Auto Agents se conectează cu API-ul Auto Drive pentru a forma o infrastructură auditabilă.